что такое gtx и rtx

Чем RTX видеокарты отличаются от GTX и что лучше

На выставке Gamescom, летом 2018 года,компания NVIDIA представила новую линейку видеокарт под названием RTX. Новинка достаточно быстро поступила в продажу и стала доступна для геймеров в начале осени 2018-го.

В данной статье мы расскажем о том, что такое RTX, чем линейка RTX отличается от GTX и что лучше выбрать, если вы решили обновить свою видеокарту.

Что такое RTX

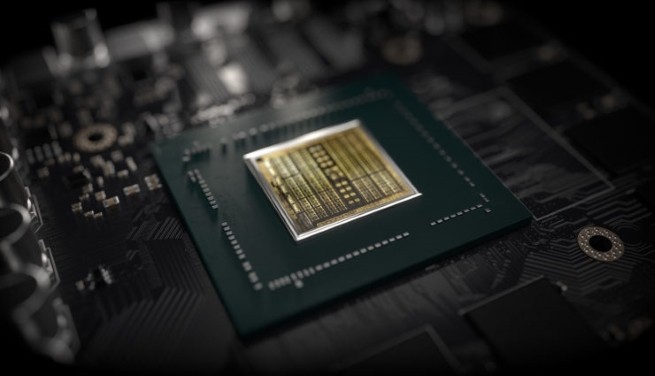

RTX – это новая серия видеокарт от компании NVIDIA, которая пришла на замену старой серии GTX.Видеокарты RTX построены на базе новой микроархитектуры Turing, которая включает в себя отдельные модули для аппаратной трассировки лучей в реальном времени (RT-ядра) и работы с искусственным интеллектом и глубинным обучением (тензорные ядра).

На данный момент серии RTX и GTX выпускаются параллельно. Сейчас к серии RTX относятся видеокарты среднего и высшего ценового диапазона, это:

А к серии GTX относятся бюджетные видеокарты, это:

В дальнейшем, скорее всего, компания NVIDIA откажется от производства видеокарт из серии GTX и полностью переключится на RTX.

Чем RTX отличается от GTX

Линейка видеокарт NVIDIA RTX имеет два основных отличия от серии видеокарт GTX, это:

RT-ядра и тензорные ядра – это отдельные модули внутри графического чипа видеокарты, и они присутствуют только на новых RTX моделях. На видеокартах серии GTX таких модулей нет.

Фактически, наличие этих ядер — это небольшой прорыв на рынке графических ускорителей, поскольку до этого подобного не было ни у NVIDIA, ни у их конкурента AMD. А в будущем, вероятней всего, наличие подобных модулей станет стандартом для всех видеокарт от обоих производителей. Косвенно это подтверждает тот факт, что поддержку аппаратного ускорения трассировки лучей уже анонсировали для игровых консолей следующего поколения.

Наличие RT и тензорных ядер открывает целый ряд новых возможностей. Так RT-ядра позволяют значительно ускорить вычисления, связанные с трассировкой лучей. Это позволит разработчикам игр создавать более реалистичное и динамичное освещение, которое сможет быстро меняться в зависимости от игровых событий. Также трассировка лучей, выполняемая ядрами RT, может применяться для создания таких эффектов, как отражения, преломления, тени и ограничение глубины резкости.

Нужно отметить, что трассировку лучшей можно использовать и на видеокартах без RT-ядер. NVIDIA даже выпустила обновление для драйверов, которое открывает эту возможность на видеокартах GTX 10-поколения. Но, без наличия RT-ядер трассировка отнимает слишком много производительности основных модулей графического процессора из-за чего сильно проседает FPS. Играть в таком формате вряд ли возможно, это скорее демонстрация самой технологии.

В свою очередь, тензорные ядра предназначены для ускорения вычислений, связанных с искусственным интеллектом и глубинным обучением. При чем это не обязательно какие-то прикладные или научные задачи. Тензорные ядра могут использоваться и в компьютерных играх, например, NVIDIA применила данную технологию сглаживания кадров. Это решение получило название DLSS. С его помощью можно значительно улучшить качество изображения в играх, при этом не расходуя вычислительную мощность основных модулей графического процессора видеокарты.

Кроме этого, RTX имеют ряд более мелких изменений, которые также выгодно отличают их от видеокарт прошлых поколений. Например, видеокарты RTX получили:

Что лучше GTX или RTX

При выборе видеокарты может возникнуть вопрос, что лучше GTX или RTX. Ответ здесь достаточно очевиден, видеокарты RTX лучше GTX практически во всем и обладают уникальными возможностями, которые не доступны для GTX. Поэтому если есть возможность, то лучше покупать именно RTX.

Но, нужно учесть, что GeForce RTX 2060, которая является самой доступной во всей линейке RTX, справляется с трассировкой лучшей достаточно плохо. При включении этой функции FPS сильно проседает и играть становится не комфортно, даже в разрешении FullHD. Поэтому для полноценного игрового опыта с трассировкой лучей вам понадобиться GeForce RTX 2070 или даже более мощная видеокарта.

Сравниваем NVIDIA RTX vs GTX: В чем отличия?

В чем разница между RTX и GTX?

Долгое время считалось, что новую видеокарту следует использовать с графическим процессором от Nvidia. И если вы так считаете, то вы конечно видели что эти графические процессоры производятся с обозначениями RTX и GTX.

Хотя с 2020 года AMD может предложить несколько действительно очень хороших альтернатив Nvidia со своими видеокартами последнего поколения (более подробно можете узнать NVIDIA vs AMD какой производитель лучше?), можно с уверенностью сказать, что Nvidia по-прежнему является одним из лучших вариантов.

В основном это связано с тем, что она долгое время остается лидером рынка и что подавляющее большинство карт, выпущенных Nvidia за последние пять лет лучше, чем то что ранее предлагала AMD.

Рассмотрим что означает каждый префикс, как и почему он использовался. Поскольку GTX старше, начнем с него.

GeForce GTX

С момента выпуска серии GeForce 7000 в 2005 году Nvidia использовала сокращенное название GTX для обозначения своих лучших видеокарт.

Было бы несправедливо сказать, что эта тенденция продолжалась вплоть до выпуска карт RTX, поскольку Nvidia начала постепенно увеличивать количество карт марки GTX. После выпуска карт серии 900 в 2014 году практически все карты GeForce имели суффикс GTX.

Увидев, что карты из эпохи до серии 900 в 2020 году уже не актуальны, в этом разделе мы обсудим только карты серий 900, 1000 и 1600. Это также хороший момент для того, чтобы разделить это обсуждение, поскольку AMD не была на одном уровне с Nvidia после выпуска карт серии 900 и вплоть до выпуска карт серии 6000 в 2020 году.

Хотя карты серии 1600 технически относятся к картам GTX, интересно отметить, что они были выпущены в 2019 году, через год после того, как в продаже появились первые карты RTX. Таким образом, несмотря на то, что GTX 1080 Ti некоторое время считалась лучшей картой GTX, на самом деле именно GTX 1660 Ti является лучшей картой GTX на рынке сегодня.

Хотя запас производительности не сильно отличается, разница в цене слишком велика, чтобы ее не учитывать. Так что, если вы хотите приобрести карту GTX, то серия GTX 1600 должна лучшим выбором. Однако у этого графического процессора есть довольно существенные недостатки по сравнению с картами RTX.

Трассировка лучей Texel eXtreme (RTX)

Прежде всего, карты RTX имеют трассировку лучей, которая представляет собой технологию, отвечающую за создание гиперреалистичных световых эффектов путем моделирования частиц в реальном времени. Одной этой вещи более чем достаточно, чтобы оправдать дополнительную разницу в стоимости.

Кроме того, с выпуском карт серии RTX 3000 доступность трассировки лучей резко возросла.

Несмотря на дату выпуска в сентябре 2020 года, доступность карт серии RTX 3000 в 2020 году по-прежнему не успевает за спросом покупателей.

Однако в определенный момент, вероятно, в первом квартале 2021 года, мы обязательно увидим, как предложение и спрос выровняются и мы сможем получить более выгодные предложения по новым видеокартам. Именно в этот момент карты серии RTX 3000 будут доступны по той же цене, что и топовые карты серии GTX 1600.

Карты серии RTX 3000 — не первые карты RTX, выпущенные Nvidia поскольку в 2018 году мы увидели серию RTX 2000, которая полностью изменила процесс графики видеоигр.

Если вы планируете покупать видеокарту серии RTX 3000, то RTX 3080, 3090 стоят дорого, поэтому если вы действительно заинтересованы в покупке карты RTX; хотите сэкономить и готовы пойти на компромиссы вы можете рассмотреть покупку RTX 3060 Ti или купить RTX 3070 которые удовлетворят большинство геймеров.

NVIDIA RTX vs GTX: в чем разница?

Если вы не в курсе последних новостей в мире аппаратного оборудования или только недавно заинтересовались сборкой своего ПК и думаете о приобретении видеокарты от Nvidia, то, несомненно, заметили, что упомянутая компания предлагает два разных на первый взгляд типа графических процессоров: GTX и RTX.

Итак, что же это все означает, в чем разница между моделями GTX и RTX, и какую из них стоит выбрать? Мы ответим на все эти вопросы, так что рекомендуем прочитать статью до конца!

Основы

Все игровые графические процессоры Nvidia принадлежат их собственному бренду GeForce, который появился в 1999 году с выпуском GeForce 256. С тех пор компания выпустила сотни различных видеокарт, а кульминацией стали три последних модельных ряда: серия GeForce 20, выпущенная в 2018 году, серия GeForce 16, выпущенная в 2019 году, и серия GeForce 30, выпущенная в 2020 году.

На сегодняшний день серии GeForce 20 и GeForce 30 состоят исключительно из графических процессоров RTX, а серия GeForce 16 – из видеокарт GTX. Итак, что же означают все эти буквы? На самом деле ни GTX, ни RTX, не являются аббревиатурами и не имеют конкретного значения как такового. Они существуют просто ради маркетинговых целей.

Nvidia использовала несколько похожих двух- и трехбуквенных обозначений, чтобы предоставить пользователям общее представление о том, какую производительность может предложить каждый графический процессор. Например, производители использовали такие обозначения, как GT, GTS, GTX, а также многие другие на протяжении многих лет, однако лишь GTX и новая RTX «выжили» до наших дней.

GeForce 20 / 30 против GeForce 16

Прежде всего мы должны отметить, что серии 20 и 16, то есть последние графические процессоры RTX и GTX, основаны на одной и той же микроархитектуре видеокарты Turing, которую Nvidia впервые представила в 2018 году. В свою очередь, серия 30 основана на новейшей архитектуре Ampere.

Однако, несмотря на то, что GeForce 20 и 16 основаны на одной архитектуре, 20-я вышла первой. После запуска в 2018 году, производители хотели сосредоточиться на расширенных функциях, которые могла предложить новая архитектура. Линейка состояла из графических процессоров верхней части среднего сегмента и high-end видеокарт, которые и могли продемонстрировать указанные функции, и это были первые модели под обозначением RTX.

Между тем, серия 16 появилась годом позже, потому что Nvidia нужно было предложить несколько более экономичных решений для тех, кто не мог позволить себе потратить больше 400 долларов на видеокарту. Эти графические процессоры, однако, не имели вышеупомянутых расширенных функций, поэтому сохранили старое обозначение GTX.

Тем не менее в настоящее время графические процессоры GTX действительно слабее, чем RTX, но так и было задумано самими разработчиками. Название RTX было введено в основном ради маркетинга, чтобы новые графические процессоры воспринимались как большой шаг вперед, как нечто действительно новое, а само обозначение было вдохновлено главной новой функцией, представленной в серии 20: трассировка лучей в реальном времени.

Сейчас трассировка лучей в реальном времени стала возможной благодаря RT-ядрам, которые встречаются только в сериях 20 и 30 и отсутствуют в моделях серии 16. Вдобавок ко всему существуют тензорные ядра, которые обеспечивают ускорение ИИ, а также повышают производительность трассировки лучей и обеспечивают суперсэмплинг глубокого обучения в играх.

Если убрать эти две ключевые характеристики из общей картины, видеокарты GTX 16 серии и графические процессоры RTX серий 20 и 30 не так уж сильно отличаются. Очевидно, что более дорогие модели RTX имеют больше транзисторов, больше ядер, лучшую память и многое другое, из-за чего они способны предложить лучшую общую производительность, чем более дешевые аналоги в лице GTX. Однако они не обязательно обеспечивают лучшее соотношение цены и качества.

Итак, что это за новые функции и стоит ли покупать графический процессор RTX?

Что такое RT ядра?

Как упоминалось выше, RT ядра представляют собой ядра графического процессора, предназначенные исключительно для трассировки лучей в реальном времени.

Так что же делает трассировка лучей с графикой видеоиграх? Технология позволяет добиться более реалистичного освещения и отражений. Это достигается путем отслеживания обратной траектории распространения луча, что позволяет графическому процессору выдавать гораздо более реалистичное моделирование взаимодействия света с окружающей средой. Рейтрейсинг по-прежнему возможен даже на графических процессорах без RT ядер, но в таком случае производительность просто ужасная, даже на флагманских моделях типа GTX 1080 Ti.

Говоря о производительности, трассировка лучей в реальном времени на самом деле сильно влияет на производительность даже при использовании с графическими процессорами RTX, что неизбежно приводит к вопросу — стоит ли вообще использовать данную технологию?

По состоянию на 2020 год чуть множество игр поддерживают трассировку лучей.

Видео выше показывает, как трассировка лучей выглядит в игре Control (2019): графические улучшения, обеспечиваемые трассировкой лучей, значительны. Однако функция сокращает показатель FPS вдвое, со стабильных 60 до 30, и это с высокопроизводительной видеокартой RTX 2070 Super!

Трассировка лучей в реальном времени — это важное достижение в области гейминга, которое в ближайшие годы значительно улучшит графику видеоигр. Тем не менее, на прямо сейчас аппаратное обеспечение недостаточно мощное, и разработчики еще не в полной мере используют потенциал функции.

Что такое тензорные ядра?

Несмотря на то, что трассировка лучей является наиболее «продаваемой» функцией графических процессоров RTX серий 20 и 30, архитектура Turing также представила еще одну важную новую функцию в основной линейке GeForce — расширенные возможности глубокого обучения, которые стали возможны с помощью специальных тензорных ядер.

Эти ядра были представлены в 2017 году в графических процессорах Nvidia Volta, однако игровые видеокарты не были основаны на этой архитектуре. Таким образом, тензорные ядра, присутствующие в моделях Turing, на самом деле являются тензорными ядрами второго поколения. Касаемо игр, то у глубокого обучения есть одно основное применение: суперсэмплинг глубокого обучения, сокращенно DLSS, который представляет собой совершенно новый метод сглаживания. Итак, как именно работает DLSS и лучше ли он, чем обычные методы сглаживания?

DLSS использует модели глубокого обучения для генерации деталей и масштабирования изображения до более высокого разрешения, тем самым делая его более резким и уменьшая искажения. Вышеупомянутые модели глубокого обучения создаются на суперкомпьютерах Nvidia, а затем приводятся в действие тензорными ядрами видеокарты.

Суперсэмплинг обеспечивает более четкое изображение, но при этом требует меньших затрат на оборудование, чем большинство других методов сглаживания. Более того, технология может заметно улучшить производительность при включенной трассировке лучей, что хорошо, учитывая, насколько высока производительность данной функции.

Однако, как и в случае с трассировкой лучей, список игр, которые в настоящее время поддерживают DLSS, к сожалению, довольно мал. Впрочем, это наверняка изменится в будущем.

Заключение

Что ж, пришло время подвести итоги: обозначение RTX было введено Nvidia в основном ради маркетинговых целей, из-за чего графические процессоры на архитектуре Turing 20-й серии выглядели как более крупное обновление, чем они есть на самом деле.

Конечно, RTX-модели оснащены крутыми новыми элементами, которые полностью раскроют свой потенциал в обозримом будущем, а что касается чистой производительности, новейшие видеокарты на архитектуре Ampere достаточно сильно опережают старые графические процессоры GTX на базе Pascal, которые продавались по примерно той же цене.

Принимая во внимание все вышесказанное, мы бы не сказали, что графические процессоры RTX стоит покупать только ради трассировки лучей и DLSS, поскольку производительность всегда должна быть на первом месте, особенно если вы хотите получить максимальную отдачу от своих денег. С другой стороны, эти технологии будут развиваться в ближайшем будущем, и через пару лет графические чипы GTX окажутся откровенно устаревшими. Если вы собираетесь приобрести новую видеокарту, то, возможно, стоит ознакомиться с данной статьей, где мы перечислили лучшие видеокарты, доступные на рынке прямо сейчас.

Считаю что трассировка лучей является не столь революционной функцией ради которой стоит обновляться на новое поколение, сколько её метод оптимизации под названием DLSS. Уже который год в сети плавают слухи что у NVIDIA в рукаве был припасён ход, позволяющий сделать реальный прогресс в плане оптимизации — но зная насколько сильно компания погрязла в маркетинге, ждать от них такого подарка «бесплатно» было бы максимально глупо, и по факту так и получилось.

Трассировка же стала тем самым триггером, который заставил их применить этот козырь, и как мы видим по тестам 2.0 версии — результаты действительно впечатляющие, а уж если и вовсе отключить Трассировку, то мы как раз и получаем тот самый долгожданный буст фпс в 2 раза, который к тому же ещё и умудряется «улучшать» картинку из натива… Просто фантастика.

У них в планах сейчас вообще стоит задача добиться включения поддержки DLSS по умолчанию на уровне настройки видеоадаптера через панель нвидии, но это ориентировочно должно быть в версии 3.0, а пока что только вчера вышло обновление под номером 2.1 которое добавляет режим «Ультра производительности» для Death Stranding — кстати есть ли по этому поводу тесты?)

Чего ждать в будущем? Первое время конечно всё будет сказочно — буст фпс в 2 раза это действительно круто, и только совсем глупые люди не будут таким пользоваться, особенно на самых бюджетных версиях RTX серии в виде 2060, которые были слегка быстрее и чутка дороже тех же 1660 версий, но по факту дадут двойной разрыв в производительности с ними.

Но почему же это чисто маркетинговая технология, которая по факту может работать на всех видеокартах, но нвидиа заботливо двигает её только под новые серии? Да потому что у неё есть аналог, и точно так же как и Crytek сделали свой софтовый вариант трассировки, AMD сделали на уровне софта аналог под названием FidelityFX. Естественно она получилась хуже, но тот факт что это всё базируется чисто на программном уровне — а не с фейковым использованием каких то там специальных ядер, намекает нам на то что кое кого сильно обманывают, но если всё таки довести до ума данную функцию и включить её поддержку на программном уровне — то AMD будет иметь серьёзный ответ на прорывные технологии предлагаемые Хуангом в 3 тысячной серии.

Краткая история компании NVIDIA в видеокартах GeForce серий GT, GTX и RTX

Краткая история компании NVIDIA в видеокартах GeForce серий GT, GTX и RTX

реклама

NVIDIA Corporation — американская технологическая компания, разработчик графических процессоров и систем-на-чипе (SoC). Разработки NVIDIA получили распространение в индустрии видеоигр, сфере профессиональной визуализации, области высокопроизводительных вычислений и автомобильной промышленности, где бортовые компьютеры NVIDIA используются в качестве основы для беспилотных автомобилей. Важным приоритетом для компании также является рынок искусственного интеллекта (ИИ).

Компания была основана в 1993 году. На III квартал 2018 года NVIDIA была крупнейшим в мире производителем PC-совместимой дискретной графики с долей 74,3% (статистика включает все графические процессоры, доступные для прямой покупки конечными пользователями — GeForce, Quadro и ускорители вычислений на базе GPU Tesla). По состоянию на январь 2018 года численность сотрудников превышала 11,5 тысяч человек. Штаб-квартира компании находится в городе Санта-Клара, штат Калифорния (США).

Желаю всем приятного просмотра!

реклама

Ещё больше интересного материала, качественного косплея и превосходных артов вы сможете найти здесь!

NV 1. Первый графический 3D-ускоритель от NVIDIA, выпущен в 1995 году.

реклама

Примечательная особенность данной карты состоит как в необычном подходе с 3D-рендерингом, когда использовались Quadratic Texture Maps, вместо привычных нынче полигонов, так и в наличии микросхемы, отвечавшей за обработку звука.

Riva 128/128ZX. В 1997 году компанией был выпущен второй графический чип, основанный на 350-нм техпроцессе, сыскавший звание «народного».

реклама

Название RIVA является акронимом Real-time Interactive Video and Animation, а цифра 128 указывает на разрядность шины. Главной «фишкой» GPU является технология рендеринга, основанной на квадратическом маппинге текстур, который не поддерживался в Direct3D.

Суффикс TNT означал, что чип способен работать с двумя текселями одновременно, а TNT сокращение от TwiN Texel. Для справки: Тексель это минимальная единица текстуры 3D объекта, а пиксель наименьшая единица текстуры 2D объекта.

Riva TNT2

В начале 1999 года компания NVIDIA начала производство графического процессора пятого поколения.

Riva TNT2 была доработанным вариантом TNT: добавлена поддержка AGP интерфейса, техпроцесс уменьшился до 250-нм, а частота чипа выросла с 90 до 150 мегагерц.

GeForce 256

Всё в том же 1999 году появился первый GPU из линейки GeForce.

Название GeForce появилось в результате конкурса, который проводился компанией. Главной фишкой GeForce 256 являлось наличие встроенного геометрического процессора, а также появился аппаратный блок трансформации и освещения (T&L). Кроме того именно с GeForce 256 началось использование самой быстрой на тот момент памяти DDR.

GeForce 2

В 2000 году на свет появился новый графический процессор, ядро которого было самым совершенным и производительным на то время.

Следует отметить, что в отличие от GeForce 2, у GeForce 3 не было GPU начального уровня, все вариации обладали высокими на тот момент частотами, 256-битной шириной шины памяти, а также 128 битной DDR памятью. Тогда же появился шейдерный движок nfiniteFX.

GeForce 4

В 2002 году появилось четвертое поколение видеокарт GeForce, под этим именем выпускалось две линейки карт, Ti – высокопроизводительные, и бюджетные с приставкой MX.

И если старшая линейка GF4 продолжала развивать архитектуру GeForce 3, то бюджетная линейка ограничилась архитектурой GeForce 2. Ядро бюджетной модели GeForce 4 MX легло в основу чипсета nForce 2.

GeForce FX. Пятое поколение процессоров GeForce появилось в 2003 году.

Приставке FX карты обязаны новой версии шейдеров Shader Model 2.0, на тот момент продвигавшими графику на новый кинематографический уровень.

GeForce 6. В 2004 году появилось шестое поколение микропроцессоров от компании NVIDIA.

Примечательной особенностью GeForce 6 являлась обработка видео PureVideo, наличие технологии SLI, а также поддержка Shader Model 3.0.

GeForce 7

Седьмое поколение графических процессоров NVIDIA появилось в 2005 году.

Линейка GeForce 7 не привнесла каких-либо революционных нововведений, однако вполне успешно продолжила развивать заложенные технологии в GeForce 6. Например, за счет изменений в поточно-конвейерной архитектуре удалось добиться повышения производительности в полтора раза, при том же количестве потоковых конвейеров.

GeForce 8

В 2006 году состоялся выпуск восьмой серии графических акселераторов GeForce.

Эта серия имела унифицированную шейдерную архитектуру, благодаря которой изменилось представление о специализированном графическом конвейере. Например, унифицированные процессоры могли проводить как геометрические, так и пиксельные, вершинные и даже физические рассчеты. Также GeForce 8 дал свет программно-аппаратной архитектуре параллельных вычислений, которая называется CUDA (Compute Unified Device Architecture).

В 2008 году появилось девятое поколение графических процессоров GeForce 9.

Новый графический чип использовал доработанную архитектуру Tesla, заложенную в предыдущей модели карт GeForce 8. Следует отметить, что эта архитектура послужила базой для карт серий: GeForce 8, GeForce 9, GeForce 100, GeForce 200 и даже GeForce 300, настолько успешной на тот момент оказалась Tesla. Относительно GeForce 9 примечательной особенностью было очередное уменьшение техпроцесса до 65нм, а позднее и до 55нм, что положительно сказалось на габаритах печатных плат, а также на энергоэффективности конечного решения.

GeForce 100

В 2009 году появилось десятое поколение графических процессоров семейства GeForce.

Самой младшей в линейке являлись карты сотой серии, о которых мало кто слышал у нас, по причине нацеленности карт на ОЕМ-рынок. Относительно технических характеристик, то G150 были урезаны вдвое относительно GTX9800, GT130 были немногим лучше GeForce 9600GSO, а G100 являлась картой начального уровня и уступала в возможностях GT9400.

GeForce 200

Всё в том же 2009 году на рынке появилось логическое продолжение карт 9 серии в лице GeForce 200.

Первыми свет увидели GTX 280 и GTX 250, которые поддерживали технологию CUDA версии 2.0, PhysX а также улучшенную PureVideo с поддержкой декодирования видео в формате H.264, VC-1 и MPEG-2. Кроме того картами поддерживался DirectX 10 и Shader Model 4.0. Позже вышедшие 210/G210, GT 220 и GT240 получили поддержку DirectX 10.1 и Shader Model 4.1

GeForce 400

В 2010 году появилось новое поколение графических процессоров, основанное на архитектуре NVIDIA Fermi, первом ускорителе в арсенале компании с поддержкой DirectX 11.

Примечательной особенностью чипа является поддержка технологий DirectCompute и OpenCL, позволяющих проводить вычисления компьютерной графики при помощи графического процессора. Также появилась поддержка Shader Model 5.0

GeForce 500

В 2010 году компания продолжила развивать архитектуру Fermi.

Графический процессор получил поддержку технологий: 3D Vision Surround, CUDA, PhysX, а также 3-Way SLI. Карты на базе GTX 590 получили поддержку NVIDIA Quad SLI. Следует отметить, что улучшения коснулись не только новых технологий, но и была проведена работа по повышению общей производительности, а также по снижению энергопотребления, по сравнению с картами предыдущего поколения.

GeForce 600

В 2012 году, спустя два года после своего анонса, миру были представлены первые графические процессоры на основе новой архитектуры Kepler.

Новая архитектура подразумевала под собой не только ряд нововведений, среди которых есть технология GPU Boost, динамически управляющая частотой чипа, но и поддержка Nvidia TXAA. Однако самой главной особенностью 600 серии является переход на 28нм техпроцесс, что благоприятно сказывается на эргономичности и энерегоэффективности конечных решений. К слову, карты 600 серии получили поддержку не только DirectX 11.0, но и частично еще не вышедшей DirectX 12

GeForce 700

В 2013 году появились карты семейства GeForce 700, которые были представлены как на базе предыдущей архитектуры Kepler, так и новейшего Maxwell.

GeForce 900

Новейшая линейка видеокарт 900 серии основана на архитектуре Maxwell.

8 июля 2016 года была представлена видеокарта среднего ценового диапазона GeForce GTX 1060, сопоставимая по производительности с GeForce GTX 980, но потребляющая намного меньше энергии.

22 июля 2016 года компания NVIDIA представила профессиональную видеокарту NVIDIA TITAN X (Pascal) (не путать с видеокартой предыдущего поколения GeForce GTX Titan X (GM200), однако она не относится к игровой серии видеокарт, несмотря на то, что она основана на новом флагманском чипе GP102. Однако по обещаниям компании в дальнейшем должен выйти игровой аналог новинки.

1 марта 2017 года в ходе мероприятия GDC 2017 компания NVIDIA представила видеокарту GeForce GTX 1080 Ti, которую глава компании назвал самым мощным игровым графическим ускорителем в мире. По словам NVIDIA, новинка на 35 % производительнее GeForce GTX 1080 и обходит даже Titan X Pascal.

GeForce RTX 20 Series — семейство графических процессоров NVIDIA, представленное 20 августа 2018 в рамках конференции Gamescom. Чипы семейства GeForce RTX 20 основаны на новой архитектуре Turing, названной в честь английского математика, логика и криптографа Алана Тьюринга. Заявлено увеличение производительности до 6 раз в области трассировки лучей по сравнению с графическими процессорами предыдущего поколения. В продаже с 20 сентября 2018 года.

Серия GeForce RTX 20 поддерживает трассировку лучей в реальном времени, которая реализована с помощью новых RT-ядер. Для увеличения детализации изображения используются решения на базе искусственного интеллекта

Ещё больше интересного материала, качественного косплея и превосходных артов вы сможете найти здесь!

А какой была ваша первая видеокарта?